Was ist ein neuronales Netzwerk und wie unterscheidet es sich von traditioneller Programmierung?

Als ich zum ersten Mal von neuronalen Netzen hörte, dachte ich, dass es sich um eine Art biologisches Konstrukt handelt. Aber als ich mich weiter damit beschäftigte, erkannte ich, dass es sich um eine Art von künstlicher Intelligenz handelt, die auf der Funktionsweise des menschlichen Gehirns basiert.

Im Gegensatz zur traditionellen Programmierung verwendet ein neuronales Netzwerk nicht nur Algorithmen und Regeln, sondern auch Daten. Es besteht aus vielen miteinander verbundenen Neuronen oder Knoten, die Informationen verarbeiten und weitergeben können. Diese Verbindungen zwischen den Neuronen werden als Gewichte bezeichnet und können während des Trainings angepasst werden.

Traditionelle Programmierung hingegen basiert auf expliziten Anweisungen und Regeln, die vom Programmierer festgelegt werden. Ein neuronales Netzwerk kann jedoch selbst lernen und Muster in Daten erkennen, ohne dass der Programmierer diese Muster explizit definiert hat.

Wie funktionieren neuronale Netze?

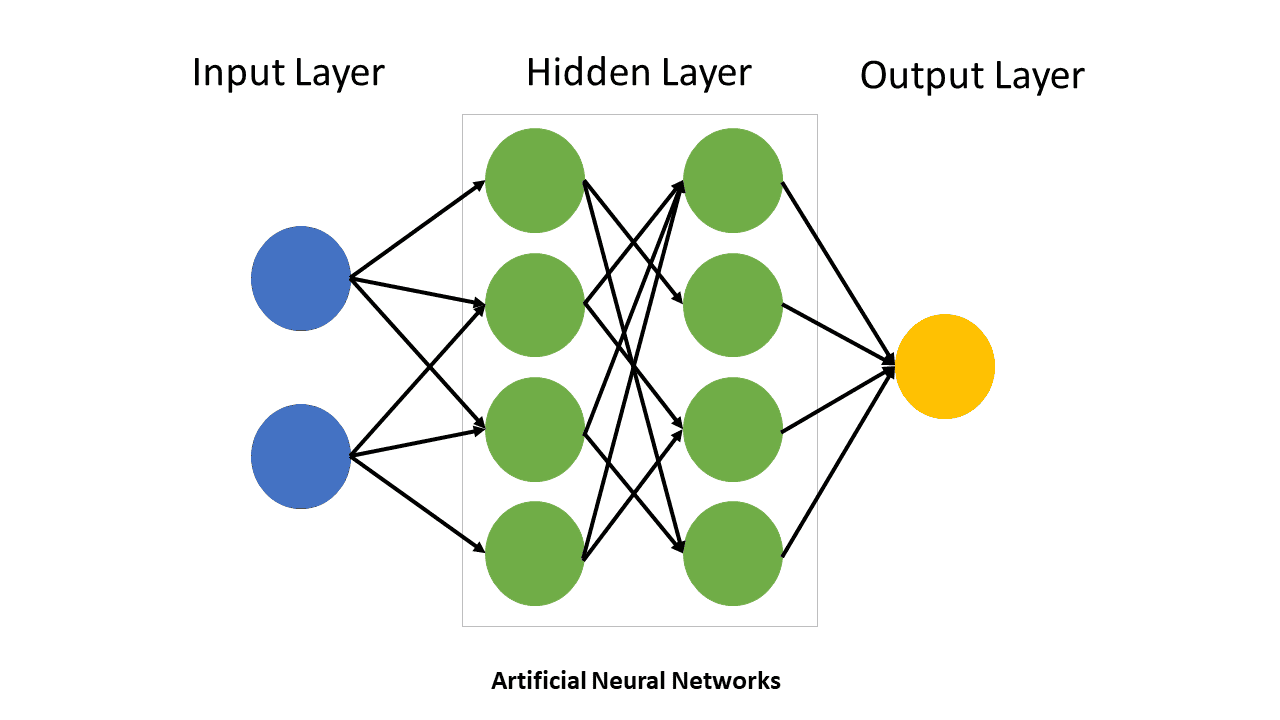

Ein neuronales Netzwerk besteht aus mehreren Schichten von Neuronen. Die erste Schicht wird als Eingabeschicht bezeichnet und empfängt Daten in Form von Vektoren oder Matrizen. Jeder Wert im Eingabevektor entspricht einem Merkmal oder einer Eigenschaft des Datensatzes.

Die Ausgabe jedes Neurons wird durch eine Aktivierungsfunktion bestimmt. Diese Funktion kann entweder linear oder nichtlinear sein und beeinflusst die Stärke der Ausgabe jedes Neurons. Die Ausgabe der ersten Schicht wird dann an die nächste Schicht weitergegeben, bis die letzte Schicht erreicht ist. Die letzte Schicht wird als Ausgabeschicht bezeichnet und gibt das Ergebnis des neuronalen Netzes zurück.

Während des Trainings werden die Gewichte zwischen den Neuronen angepasst, um die Genauigkeit des Modells zu verbessern. Dies geschieht durch Backpropagation, bei dem der Fehler zwischen den tatsächlichen und vorhergesagten Ausgaben durch das Netzwerk propagiert wird, um die Gewichte anzupassen.

Wie sind künstliche Neuronen nach biologischen Neuronen im Gehirn modelliert?

Die Idee, künstliche Neuronen zu schaffen, geht auf den amerikanischen Mathematiker Warren McCulloch und den Neurophysiologen Walter Pitts zurück. Sie entwickelten in den 1940er Jahren ein Modell für neuronale Netze, das auf biologischen Neuronen im Gehirn basiert.

Ein biologisches Neuron besteht aus einem Zellkörper, Dendriten und einem Axon. Dendriten empfangen Signale von anderen Neuronen und leiten sie zum Zellkörper weiter. Wenn genügend Signale empfangen wurden, erzeugt das Neuron ein Signal entlang des Axons.

Ein künstliches neuronales Netzwerk besteht aus vielen miteinander verbundenen künstlichen Neuronen oder Knoten. Jeder Knoten hat eine Eingabe- und eine Ausgabevariable sowie eine Aktivierungsfunktion. Die Eingaben entsprechen den Signalen von anderen Knoten oder der Eingabeschicht, während die Ausgabe die Signale an andere Knoten oder die Ausgabeschicht weiterleitet.

Die Aktivierungsfunktion in einem künstlichen Neuron bestimmt, ob das Neuron aktiviert wird oder nicht. Es gibt verschiedene Arten von Aktivierungsfunktionen, wie z.B. Sigmoid-, ReLU- und Tanh-Funktionen. Diese Funktionen sind nichtlinear und ermöglichen es dem Netzwerk, komplexe Muster in den Daten zu erkennen.

Was ist ein Perzeptron und wie funktioniert es innerhalb eines neuronalen Netzwerks?

Perzeptron

Ein Perzeptron ist eine Art von künstlichem Neuron, das in einem einfachen neuronalen Netzwerk verwendet wird. Es verarbeitet Eingaben und gibt Ausgaben basierend auf einer bestimmten Regel aus. Ein Perzeptron besteht aus mehreren Eingängen, einer Schwellenwertfunktion und einem Ausgang. Die Eingänge sind mit Gewichten verbunden, die bestimmen, wie wichtig jeder Eingang für die Ausgabe des Perzeptrons ist.

Neuronales Netzwerk

Ein neuronales Netzwerk besteht aus vielen miteinander verbundenen künstlichen Neuronen, einschließlich Perzeptronen. Diese Neuronen arbeiten zusammen, um komplexe Aufgaben zu lösen, indem sie Muster in den Daten erkennen. Die Verbindungen zwischen den Neuronen werden durch Gewichte dargestellt, die während des Trainingsprozesses angepasst werden.

Funktionsweise

Wenn ein Signal an ein Perzeptron gesendet wird, multipliziert es jede Eingabe mit ihrem entsprechenden Gewicht und summiert dann diese Produkte auf. Wenn die Summe größer als der Schwellenwert ist, gibt das Perzeptron eine bestimmte Ausgabe aus. Andernfalls gibt es eine andere Ausgabe aus.

Wie werden Gewichte den Verbindungen zwischen Neuronen in einem neuronalen Netzwerk zugewiesen?

Gewichtszuweisung

Die Gewichte zwischen den Neuronen in einem neuronalen Netzwerk werden während des Trainingsprozesses zugewiesen. Zu Beginn des Trainings werden die Gewichte zufällig initialisiert. Während das Netzwerk trainiert wird, passen Algorithmen wie der Backpropagation-Algorithmus die Gewichte an, um die Leistung des Netzwerks zu verbessern.

Backpropagation

Backpropagation ist ein Algorithmus zur Anpassung von Gewichten in einem neuronalen Netzwerk. Es funktioniert durch Berechnung der Fehler zwischen den tatsächlichen Ausgaben des Netzes und den erwarteten Ausgaben. Der Fehler wird dann rückwärts durch das Netzwerk propagiert, um zu bestimmen, wie viel Einfluss jeder Neuroneneingang auf den Fehler hat. Die Gewichte werden dann entsprechend angepasst, um diesen Einfluss zu reduzieren.

Was ist Backpropagation und wie hilft es, die Gewichte in einem neuronalen Netzwerk anzupassen?

Backpropagation

Backpropagation ist ein Algorithmus zur Anpassung von Gewichten in einem neuronalen Netzwerk. Es funktioniert durch Berechnung der Fehler zwischen den tatsächlichen Ausgaben des Netzes und den erwarteten Ausgaben. Der Fehler wird dann rückwärts durch das Netzwerk propagiert, um zu bestimmen, wie viel Einfluss jeder Neuroneneingang auf den Fehler hat. Die Gewichte werden dann entsprechend angepasst, um diesen Einfluss zu reduzieren.

Gewichtsoptimierung

Die Anpassung der Gewichte durch Backpropagation hilft dabei, die Leistung eines neuronalen Netzwerks zu verbessern. Indem sie die Gewichte optimieren, können Netzwerke Muster in den Daten besser erkennen und genauere Vorhersagen treffen.

Overfitting-Vermeidung

Es ist jedoch wichtig zu beachten, dass das Anpassen der Gewichte durch Backpropagation dazu führen kann, dass ein Netzwerk zu gut an die Trainingsdaten angepasst wird. Dies kann Overfitting verursachen, bei dem das Netzwerk zwar auf den Trainingsdaten sehr gut abschneidet, aber auf neuen Daten schlecht abschneidet. Um dies zu vermeiden, müssen Techniken wie Dropout-Regularisierung verwendet werden.

Wie bestimmen Aktivierungsfunktionen die Ausgabe jedes Neurons in einem neuronalen Netzwerk?

Aktivierungsfunktionen

Aktivierungsfunktionen sind Funktionen, die auf die Eingabe eines Neurons angewendet werden, um seine Ausgabe zu bestimmen. Sie sind wichtig für die Fähigkeit des Netzes, komplexe Muster in den Daten zu erkennen und präzise Vorhersagen zu treffen.

Funktionsweise

Wenn eine Eingabe an ein Neuron gesendet wird, wird sie mit den Gewichten der Verbindungen zwischen den Neuronen multipliziert. Die Summe dieser Produkte wird dann an die Aktivierungsfunktion weitergeleitet. Die Aktivierungsfunktion wendet dann eine mathematische Operation auf diese Summe an und gibt das Ergebnis als Ausgabe des Neurons aus.

Typen von Aktivierungsfunktionen

Es gibt verschiedene Arten von Aktivierungsfunktionen, darunter die Sigmoid-Funktion, die ReLU-Funktion und die Softmax-Funktion. Jede Funktion hat ihre eigenen Vor- und Nachteile und wird in verschiedenen Situationen verwendet.

Welche Rolle spielen Bias-Knoten in einem neuronalen Netzwerk?

Bias-Knoten

Ein Bias-Knoten ist ein zusätzliches Neuron in einem neuronalen Netzwerk, das immer aktiviert ist. Es gibt dem Netzwerk eine zusätzliche Möglichkeit, Muster in den Daten zu erkennen und präzisere Vorhersagen zu treffen.

Funktionsweise

Bias-Knoten sind mit jedem Neuron in der nächsten Schicht des Netzes verbunden. Sie fügen einen konstanten Wert zur Eingabe jedes Neurons hinzu, bevor sie durch die Aktivierungsfunktion geleitet werden. Dies hilft dem Netzwerk, Muster in den Daten besser zu erkennen und genauere Vorhersagen zu treffen.

Verwendung von Bias-Knoten

Bias-Knoten sind ein wichtiger Bestandteil eines neuronalen Netzes und werden fast immer verwendet. Sie können dazu beitragen, Overfitting zu vermeiden und die Leistung des Netzes insgesamt zu verbessern.

Wie tragen versteckte Schichten zur Gesamtleistung eines neuronalen Netzwerks bei?

Versteckte Schichten

Versteckte Schichten sind Schichten von Neuronen zwischen der Eingabeschicht und der Ausgabeschicht eines neuronalen Netzwerks. Sie helfen dabei, komplexe Muster in den Daten zu erkennen und präzisere Vorhersagen zu treffen.

Funktionsweise

Wenn Daten in ein neuronales Netzwerk eingegeben werden, durchlaufen sie die versteckten Schichten, bevor sie zur Ausgabeschicht weitergeleitet werden. Jede Schicht besteht aus vielen Neuronen, die miteinander verbunden sind. Diese Verbindungen haben Gewichte, die während des Trainingsprozesses angepasst werden.

Verbesserung der Leistung

Versteckte Schichten tragen wesentlich zur Gesamtleistung eines neuronalen Netzwerks bei. Sie helfen dabei, komplexe Muster in den Daten zu erkennen und präzisere Vorhersagen zu treffen. Wenn ein Netzwerk nicht über versteckte Schichten verfügt, kann es nur einfache lineare Operationen durchführen und ist nicht in der Lage, komplexe Muster zu erkennen.

Was ist Overfitting und wie kann es vermieden werden, ein neuronales Netzwerk zu trainieren?

Overfitting

Overfitting tritt auf, wenn ein neuronales Netzwerk zu gut an die Trainingsdaten angepasst wird. Dies führt dazu, dass das Netzwerk auf neuen Daten schlecht abschneidet und daher nutzlos ist.

Vermeidung von Overfitting

Es gibt verschiedene Techniken zur Vermeidung von Overfitting beim Training eines neuronalen Netzes. Eine Möglichkeit besteht darin, Dropout-Regularisierung zu verwenden, bei der zufällig einige Neuronen während des Trainings deaktiviert werden. Eine andere Möglichkeit besteht darin, mehr Trainingsdaten zu sammeln oder künstlich generierte Daten zu verwenden. Es ist auch wichtig, das Netzwerk nicht zu lange zu trainieren und die Anzahl der versteckten Schichten und Neuronen im Netzwerk angemessen zu wählen.

Wichtigkeit der Vermeidung von Overfitting

Overfitting kann dazu führen, dass ein neuronales Netzwerk nutzlos wird, da es nur auf den Trainingsdaten gut abschneidet. Es ist daher wichtig, Techniken zur Vermeidung von Overfitting zu verwenden, um sicherzustellen, dass das Netzwerk auf neuen Daten präzise Vorhersagen treffen kann.

Wie kann Dropout-Regularisierung die Genauigkeit eines neuronalen Netzwerkmodells verbessern?

Dropout-Regularisierung

Dropout-Regularisierung ist eine Technik zur Vermeidung von Overfitting beim Training eines neuronalen Netzes. Es funktioniert durch zufälliges Deaktivieren einiger Neuronen während des Trainingsprozesses.

Funktionsweise

Während des Trainingsprozesses werden einige Neuronen in jeder Schicht des Netzes zufällig deaktiviert. Dadurch wird verhindert, dass das Netzwerk zu sehr an die Trainingsdaten angepasst wird und Overfitting vermieden wird. Wenn das Netzwerk jedoch auf neue Daten angewendet wird, werden alle Neuronen aktiviert.

Vorteile der Dropout-Regularisierung

Die Dropout-Regularisierung hat gezeigt, dass sie die Leistung eines neuronalen Netzes verbessern kann. Indem sie Overfitting vermeidet, hilft sie dem Netzwerk dabei, präzisere Vorhersagen zu treffen und komplexe Muster in den Daten zu erkennen.

Was sind Faltungsneuronale Netze und wie werden sie für Bilderkennungsaufgaben verwendet?

Faltungsneuronale Netze

Faltungsneuronale Netze sind eine Art von neuronalen Netzwerken, die speziell für die Verarbeitung von Bildern entwickelt wurden. Sie verwenden Faltungsschichten, um Merkmale in den Daten zu erkennen und präzise Vorhersagen zu treffen.

Funktionsweise

Ein Faltungsneuronales Netz besteht aus mehreren Schichten, darunter Eingabe-, Faltung-, Pooling- und Ausgabeschichten. Die Eingabeschicht empfängt das Bild als Eingabe. Die Faltungsschichten verwenden Filter, um Merkmale im Bild zu erkennen, wie z.B. Kanten oder Texturen. Die Pooling-Schichten reduzieren die Größe der Merkmalskarten und erhöhen damit die Rechenleistung des Netzes. Die Ausgabeschicht gibt schließlich eine Vorhersage aus.

Anwendungen der Faltungsneuronalen Netze

Faltungsneuronale Netze werden häufig für Bilderkennungsaufgaben eingesetzt, wie z.B. Gesichtserkennung oder Objekterkennung in Fotos. Sie haben auch Anwendungen in anderen Bereichen wie der Sprachverarbeitung oder der medizinischen Bildgebung.

Wie verarbeiten rekurrente neuronale Netze sequentielle Daten, wie zum Beispiel natürliche Sprachverarbeitung oder Zeitreihenanlyse?

Rekurrente Neuronale Netze

Rekurrente Neuronale Netze sind eine Art von neuronalen Netzen, die für die Verarbeitung von sequentiellen Daten entwickelt wurden. Sie können Muster in den Daten erkennen und präzise Vorhersagen treffen.

Funktionsweise

Ein Rekurrentes Neuronales Netz besteht aus mehreren Schichten, darunter Eingabe-, versteckte- und Ausgabeschichten. Die versteckten Schichten verwenden Rückkopplungsschleifen, um Informationen über vergangene Zustände des Netzes zu speichern. Dadurch kann das Netzwerk Muster in den Daten erkennen und Vorhersagen basierend auf diesen Mustern treffen.

Anwendungen der Rekurrenten Neuronalen Netze

Rekurrente Neuronale Netze werden häufig für Anwendungen wie natürliche Sprachverarbeitung oder Zeitreihenanlyse eingesetzt. Sie haben auch Anwendungen in anderen Bereichen wie der Musikgenerierung oder der Aktienprognose.

Was ist Transferlernen und wie können vortrainierte Modelle verwendet werden, um die Leistung auf neuen Aufgaben zu verbessern?

Transferlernen

Transferlernen ist eine Technik zur Verbesserung der Leistung eines neuronalen

Wie kann die Hyperparameterabstimmung die Leistung eines neuronalen Netzwerkmodells optimieren?

Was sind Hyperparameter?

Hyperparameter sind Parameter, die nicht direkt im neuronalen Netzwerkmodell trainiert werden, sondern vor dem Training festgelegt werden müssen. Dazu gehören beispielsweise die Lernrate, Batch-Größe und Anzahl der Epochen. Die richtige Wahl dieser Hyperparameter ist entscheidend für die Leistung des Modells.

Warum ist eine Abstimmung der Hyperparameter wichtig?

Eine sorgfältige Abstimmung der Hyperparameter kann dazu beitragen, dass das neuronale Netzwerkmodell seine beste Leistung erbringt. Wenn die Hyperparameter falsch gewählt werden, kann dies zu einer schlechten Leistung des Modells führen oder sogar dazu führen, dass das Modell nicht konvergiert.

Wie funktioniert eine Abstimmung der Hyperparameter?

Es gibt verschiedene Methoden zur Abstimmung der Hyperparameter, einschließlich manueller Suche und automatisierter Suche mit Algorithmen wie Grid Search oder Random Search. Bei der manuellen Suche wird versucht, durch Ausprobieren verschiedener Kombinationen von Hyperparametern das beste Ergebnis zu erzielen. Automatisierte Suchalgorithmen können diesen Prozess beschleunigen und effektiver gestalten.

Was sind einige aktuelle Herausforderungen und Einschränkungen im Bereich des Deep Learnings?

Beschränkte Datenmengen

Deep Learning-Modelle benötigen in der Regel große Mengen an Daten zum Training. In einigen Bereichen gibt es jedoch nur begrenzte Datenmengen, was die Entwicklung von Modellen erschwert. Es gibt zwar Techniken wie Transfer Learning, um das Problem zu mildern, aber es bleibt eine Herausforderung.

Erklärbarkeit von Modellen

Deep Learning-Modelle sind oft sehr komplex und schwer zu verstehen. Dies kann ein Problem darstellen, wenn Entscheidungen auf der Grundlage dieser Modelle getroffen werden müssen. Die Erklärbarkeit von Modellen ist daher ein wichtiges Thema in der Forschung.

Hardware-Einschränkungen

Deep Learning-Modelle sind sehr rechenintensiv und erfordern leistungsstarke Hardware wie GPUs oder TPUs. Nicht jeder hat jedoch Zugang zu solcher Hardware, insbesondere in Entwicklungsländern oder kleineren Unternehmen. Dies kann die Verbreitung von Deep Learning einschränken.

Zusammenfassung

Obwohl Deep Learning enorme Fortschritte gemacht hat und in vielen Bereichen Anwendung findet, gibt es immer noch Herausforderungen und Einschränkungen. Die Abstimmung von Hyperparametern kann dazu beitragen, dass neuronale Netzwerkmodelle ihre beste Leistung erbringen, während beschränkte Datenmengen, Erklärbarkeit von Modellen und Hardware-Einschränkungen weiterhin wichtige Themen in der Forschung sind.

Zusammenfassend lässt sich sagen, dass neuronale Netze aufgrund ihrer Fähigkeit, Muster zu erkennen und Entscheidungen zu treffen, in vielen Bereichen der künstlichen Intelligenz eingesetzt werden. Obwohl die Funktionsweise komplex sein kann, ist es wichtig zu verstehen, wie sie arbeiten, um ihre Vorteile voll ausschöpfen zu können. Wenn Sie Interesse an unseren AI-Dienstleistungen haben oder weitere Fragen haben, zögern Sie nicht uns zu kontaktieren und besuchen Sie unsere Website!

Wie machen neuronale Netzwerke Sinn aus Daten?

Neuronale Netze nutzen Trainingsdaten, um ihre Genauigkeit zu verbessern, während sie lernen. Sobald diese Algorithmen optimiert sind, werden sie jedoch zu leistungsstarken Werkzeugen in den Bereichen Informatik und künstliche Intelligenz. Sie ermöglichen uns, Daten schnell zu kategorisieren und zu gruppieren.

Sind neuronale Netze wirklich wie das Gehirn?

Neuronale Netze, die Computersysteme sind, die die Struktur des menschlichen Gehirns nachahmen, werden in einer Vielzahl von künstlicher Intelligenz Anwendungen wie Spracherkennung, Computer Vision und medizinischer Bildanalyse eingesetzt.

Wie imitiert ein neuronales Netzwerk das menschliche Gehirn?

Ein grundlegendes neuronales Netzwerk ist ein Softwareprogramm, das aus künstlichen Neuronen besteht und darauf ausgelegt ist, das menschliche Gehirn nachzuahmen. Wie die Neuronen in unserem Gehirn hat es mehrere Schichten von Neuronen, wobei die erste Schicht Eingaben wie Bilder, Videos, Geräusche und Texte erhält.

Was ist ein Beispiel für ein neuronales Netzwerk im wirklichen Leben?

Neuronale Netzwerke werden verwendet, um Probleme zu lösen, die das Erkennen von Mustern erfordern. Sie können beispielsweise darauf trainiert werden, handschriftliche Ziffern zu erkennen oder zwischen Objekten wie Autos, Hunden und Lastwagen zu unterscheiden, wie es beim selbstfahrenden Auto von Google demonstriert wurde.

Warum sind neuronale Netze so leistungsfähig?

Neuronale Netze sind äußerst effektiv, da sie fast jede Funktion genau vorhersagen können. Indem ein Problem als mathematische Funktion dargestellt wird und entsprechende Daten vorhanden sind, kann ein Deep-Learning-Modell diese Funktion mit ausreichenden Ressourcen approximieren.

Erstellen Gedanken neuronale Verbindungen?

Wenn Sie beginnen, einen neuen Denkprozess zu übernehmen und ihn konsequent umzusetzen, durchläuft Ihr Gehirn physische Veränderungen und entwickelt einen neuen neuronalen Pfad für diese Art des Denkens. Im Laufe der Zeit wird dieser Pfad zu Ihrem Standard-Modus des Denkens. Durch die Schaffung neuer Dendriten im Gehirn können Sie den Informationsaustausch zwischen Neuronen erleichtern.